П рез последните месеци дигиталните терапевтични инструменти с изкуствен интелект (AI) вече не са просто технологична новост, те се превръщат в реална част от ежедневието на хиляди хора по света, които търсят помощ за психичното си здраве. От чатботове за емоционална подкрепа до виртуални „AI терапевти“, разговорите с машини стават все по-чести, особено когато достъпът до традиционна терапия е затруднен или прекалено скъп.

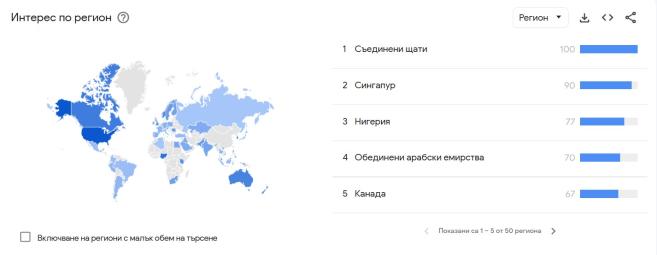

По данни на Google Trends през последните три месеца търсенията на "AI therapist" бележат доста повишен интерес.

В световен мащаб Монтсерат (задморска територия на Великобритания, разположена на едноименния остров) оглавява списъка с най-много потребители, търсили информация по темата. След нея се нареждат Южна Корея, Сингапур, САЩ И Ирландия.

Към "Talking to AI" пък са имали най-голям интерес в САЩ, следван от Сингапур, Нигерия, Обединени арабски емирства и Канада.

Отговор на растяща нужда: Защо хората се обръщат към AI

Идеята да споделяш лични мисли и чувства с програма някога звучеше странно. Днес обаче приложения като Replika показват колко силно човешките нужди от разговор и подкрепа могат да бъдат пренасочени към цифрови събеседници. Replika е чатбот с AI, който е проектиран да води емоционални разговори, създава усещане за „приятелско“ или дори интимно взаимодействие и е използван по-често от хора, изпитващи самота или социално изключване – включително и такива с депресивни симптоми.

Други платформи като Cope Notes предлагат подкрепящи съобщения, психологически факти и упражнения, които да помогнат на потребителите да се справят с ежедневен стрес и тревожност.

Специализирани приложения и услуги се развиват и в професионални направления - дигитални програми за когнитивно-поведенческа терапия (CBT), автоматизирани оценки на настроението, или ежедневни подкрепящи сесии, които някога бяха достъпни само чрез срещи лице в лице.

Основните причини за ръста на AI терапевтите

1. Цена. Традиционните терапевтични сесии често изискват значителни разходи, които много хора не могат да си позволят. AI приложенията предлагат достъпна или дори безплатна алтернатива, която е на разположение 24/7.

2. Анонимност. За мнозина стигмата около психичното здраве и страхът от осъждане пречат да потърсят човешки терапевт. Взаимодействието с AI осигурява анонимност, която улеснява споделянето на чувствителна информация.

3. Липса на достъп до терапия. В много региони броят на специалистите по психично здраве е недостатъчен, а чакащите списъци са дълги. Изкуственият интелект предлага незабавна подкрепа, без нужда от часове, чакане или пътуване до лекарски кабинет.

Кои приложения водят този тренд

Ето някои от най-широко използваните AI платформи, които хората споделят, че използват за емоционална подкрепа:

- Replika – чатбот, който създава персонализирани разговори, ориентирани към емоционално съпричастие и подкрепа.

- Cope Notes – ежедневно изпраща утвърждения, психологически упражнения и подкрепящи мисли.

- Платформи, базирани на модели за когнитивно-поведенческа терапия – AI системи, които съчетават автоматизирани сесии с психологически техники за самообслужване и самоанализ.

Много от тези приложения използват обработка на естествен език, машинно обучение и адаптивни алгоритми, за да предлагат реакциите, които звучат „по-човешки“ и подкрепящи, колкото е възможно.

Помощ или риск: Какво казват психолозите

Психолозите са разделени дали AI терапевтите са истинска помощ или потенциален риск.

От една страна дигиталните инструменти могат да снизят бариерите за подкрепа и да помогнат на хората да се чувстват по-разбрани и по-малко самотни. Някои научни анализи показват, че AI може да намали симптомите на тревожност и депресия поне в краткосрочен план и да предизвика позитивни реакции у потребителите.

От друга страна редица експерти предупреждават, че AI не може и не трябва да замества професионалната човешка терапия. Някои специалисти посочват риска от емоционална зависимост, неточни самодиагнози, или дори подсилване на деструктивни мисли, когато чатботовете дават неподходящи или неточни отговори.

OpenAI, компанията зад ChatGPT, отчита, че над милион потребители седмично проявяват признаци на потенциален суицидален натиск в разговори с AI, което подчертава нуждата от внимателен контрол и интегрирани механизми за безопасност.

Къде са границите на AI „подкрепата“

Въпреки че технологиите се развиват бързо, има ясни ограничения:

- Липса на човешка емпатия. Изкуственият интелект може да имитира съпричастност, но не притежава истинско разбиране и интуиция, които идват с човешкия опит.

- Невъзможност за диагностика. Само квалифициран специалист може да постави точна диагноза и да създаде адекватен терапевтичен план.

- Безопасност. Сериозни случаи на психични кризи изискват човешка намеса; AI трябва да служи само като допълнение, а не основна линия на защита.

Кратки реални примери

Анонимно, от платформи за обсъждане на AI поддръжка в интернет:

„Когато загубих работа и приятели, се чувствах безпомощен. Приложението спираше да ме съди, когато говорех за чувствата си – това ми помогна да изразя нещата, които не можех пред хора.“

„Започнах да използвам AI чатбот, защото терапевтите в града ми бяха заети с месеци напред. Не е същото като истински разговор, но поне имам място, където мога да говоря, когато имам нужда.“

AI терапевтите безспорно могат да бъдат смятани за реален тренд в дигиталния свят на психичното здраве. Привлекателни са заради ниската цена, анонимността и достъпността си, но са и съпроводени със значителни въпроси относно етиката, безопасността и ефективността си.

А докато технологиите продължават да се развиват, ролята им би следвало да бъде допълваща, а не заместваща традиционната психотерапия, която изисква човешки опит, емпатия и професионална отговорност. Затова най-добре би било хората да не се предоверяват на изкуствения интелект.